O cenário da IA mudou drasticamente. Em janeiro de 2025, o DeepSeek R1 irrompeu na cena — um modelo de raciocínio de pesos abertos que alcançou performance de classe GPT-4 enquanto era completamente auto-hospedável. Enviou ondas de choque pela indústria, apagando brevemente quase 1 trilhão de dólares da capitalização de mercado da Nvidia e forçando cada equipe tech a fazer uma pergunta simples: por que ainda estamos pagando por IA na nuvem?

Um ano depois, a resposta é ainda mais clara. DeepSeek R1 e suas variantes destiladas funcionam perfeitamente em hardware comum via Ollama. ChatGPT permanece um produto de nuvem polido — mas com custo recorrente, com seus dados fluindo pelos servidores da OpenAI.

Nesta comparação abrangente, analisaremos custo, privacidade, performance e casos de uso para ajudar você a decidir qual caminho é certo para sua equipe em 2026.

TL;DR — A comparação rápida

| Recurso | DeepSeek R1 (Auto-hospedado) | ChatGPT (Nuvem OpenAI) |

|---|---|---|

| Hospedagem | Seu hardware / VPS | Servidores OpenAI |

| Modelo de custo | Hardware único + eletricidade | $20–200/mês por usuário (assinatura) ou API pay-per-token |

| Privacidade de dados | 100% local — nada sai da sua rede | Dados processados nos servidores OpenAI |

| Acesso ao modelo | Pesos abertos (licença MIT) | Proprietário, código fechado |

| Uso offline | ✅ Funcionalidade completa offline | ❌ Requer internet |

| Customização | Fine-tuning, quantização, livremente modificável | Limitado a prompts de sistema e GPTs |

| Qualidade do raciocínio | Comparável ao GPT-4o em benchmarks de matemática e código | Estado da arte com GPT-4o / o1 |

| Facilidade de setup | ~10 minutos com Ollama | Registre-se e vá |

| Tamanhos do modelo | 1.5B a 671B parâmetros | N/A (apenas nuvem) |

| Limites de taxa | Nenhum — limitado apenas pelo seu hardware |

Por que o DeepSeek R1 mudou tudo

A revolução dos pesos abertos

DeepSeek R1 não era apenas mais um modelo open source. Foi a prova de que um laboratório de IA chinês poderia produzir capacidades de raciocínio que rivalizavam com o melhor da OpenAI — e então liberar os pesos gratuitamente. A família de modelos vai desde uma versão destilada de 1.5B (roda em Raspberry Pi) até o colosso completo de 671B parâmetros Mixture-of-Experts.

Resultados-chave de benchmark que chamaram atenção:

- AIME 2024 (Matemática): DeepSeek R1 pontuou 79.8%, comparável ao o1-mini da OpenAI

- Codeforces (Programação competitiva): Rating Elo de 2.029 — rivalizando com os melhores competidores humanos

- MATH-500: 97.3% de precisão, superando GPT-4o

- GPQA Diamond (Ciência nível graduação): 71.5%, competitivo com o1-preview

A mensagem era inequívoca: você não precisa mais de uma conta API de $200/mês para acessar raciocínio de fronteira.

Por que importa agora

Em 2026, o ecossistema DeepSeek amadureceu significativamente:

- Ollama fornece deploy de um comando para todas as variantes DeepSeek R1

- Modelos quantizados (Q4_K_M, Q8) permitem que o destilado 70B rode suavemente em um MacBook Pro com 64GB RAM

- Open WebUI te dá uma interface tipo ChatGPT sobre seu modelo local

- Fine-tunes da comunidade existem para cada domínio do jurídico ao médico à revisão de código

Comparação de custos: os números não mentem

Preços ChatGPT em 2026

| Plano | Preço | O que você ganha |

|---|---|---|

| Gratuito | $0 | Acesso GPT-4o limitado, taxa limitada |

| Plus | $20/mês | Mais GPT-4o, acesso o1, DALL-E, navegação |

| Pro | $200/mês | Acesso ilimitado a todos os modelos, modo o1 Pro |

| Team | $25–30/usuário/mês | Recursos de workspace, controles admin |

| Enterprise | Personalizado | SSO, compliance, suporte dedicado |

Para uma equipe de 10 desenvolvedores usando ChatGPT Plus, isso é $2.400/ano mínimo. Uso pesado de API pode facilmente empurrar custos para $10.000–50.000/ano.

Custos DeepSeek R1 auto-hospedado

A beleza do auto-hospedamento: custos são fixos e previsíveis.

| Setup | Custo hardware | Custo mensal | Nível de performance |

|---|---|---|---|

| MacBook Pro M4 Max (128GB) | ~$4.000 (já tem?) | ~$5 eletricidade | Roda destilado 70B confortavelmente |

| Desktop com RTX 4090 (24GB) | ~$2.000 GPU | ~$10 eletricidade | Roda destilado 32B em alta velocidade |

| VPS (Hetzner, 8 vCPU, 32GB) | — | ~$30/mês | Roda destilado 14B para equipe pequena |

| Servidor dual RTX 3090 | ~$3.000 total | ~$20 eletricidade | Roda destilado 70B, serve 5–10 usuários |

Análise de break-even para equipe de 10 pessoas:

- ChatGPT Plus para 10 usuários: $200/mês = $2.400/ano

- DeepSeek R1 auto-hospedado em VPS Hetzner: $30/mês = $360/ano

- Economia: $2.040/ano (85%)

Privacidade: o elefante na sala de servidores

O que acontece com ChatGPT

Quando você envia um prompt para ChatGPT:

- Seus dados viajam pela internet para servidores da OpenAI (hospedados no Microsoft Azure)

- São processados, potencialmente logados e armazenados de acordo com as políticas de retenção de dados da OpenAI

- A política de privacidade da OpenAI permite uso de seus dados para melhoria do modelo (a menos que você opte por não participar via configurações de API ou plano Enterprise)

- Você está sujeito à jurisdição dos EUA, independentemente de onde esteja localizado

Para indivíduos conversando casualmente, isso é aceitável. Para negócios lidando com código proprietário, documentos legais, dados de pacientes, registros financeiros ou segredos comerciais, é inaceitável.

O que acontece com DeepSeek R1 auto-hospedado

Seus dados nunca saem da sua máquina. Ponto.

- Prompts são processados localmente na sua CPU/GPU

- Sem telemetria, sem log para servidores externos

- Compliance completa GDPR/HIPAA por padrão — dados permanecem na sua jurisdição

- Deploy air-gapped possível para segurança máxima

- Você controla retenção, criptografia e políticas de acesso

Performance: como eles realmente se comparam?

Onde ChatGPT (GPT-4o / o1) ganha

- ✅Capacidades multimodais: compreensão de imagens, geração DALL-E, modo de voz

- ✅Navegação e plugins: acesso web em tempo real, execução de código

- ✅Janelas de contexto maiores: até 128K tokens com GPT-4o

- ✅Raciocínio de ponta: o1 e o1-pro para problemas complexos de múltiplos passos

- ✅Setup zero: funciona instantaneamente de qualquer navegador

Onde DeepSeek R1 ganha

- ✅Sem limites de taxa: gere tanto texto quanto seu hardware permitir

- ✅Latência consistente: sem fila, sem mensagens "estamos experimentando alta demanda"

- ✅Customização: fine-tuning nos seus dados de domínio para performance especializada superior

- ✅Processamento em lote: processe milhares de documentos durante a noite sem custos de API

- ✅Reprodutibilidade: mesmo modelo, mesmos pesos, saídas determinísticas

Guia de setup rápido: DeepSeek R1 + Ollama + Open WebUI

Passo 1: Instalar Ollama

# macOS / Linux

curl -fsSL https://ollama.com/install.sh | sh

# Ou no macOS via Homebrew

brew install ollamaPasso 2: Baixar um modelo DeepSeek R1

# Leve (4GB RAM mínimo) — bom para testes

ollama pull deepseek-r1:8b

# Médio (16GB RAM) — driver diário sólido

ollama pull deepseek-r1:14b

# Usuário avançado (32-64GB RAM) — capacidade de raciocínio quase completa

ollama pull deepseek-r1:32b

# Modo fera (64GB+ RAM ou multi-GPU) — qualidade máxima

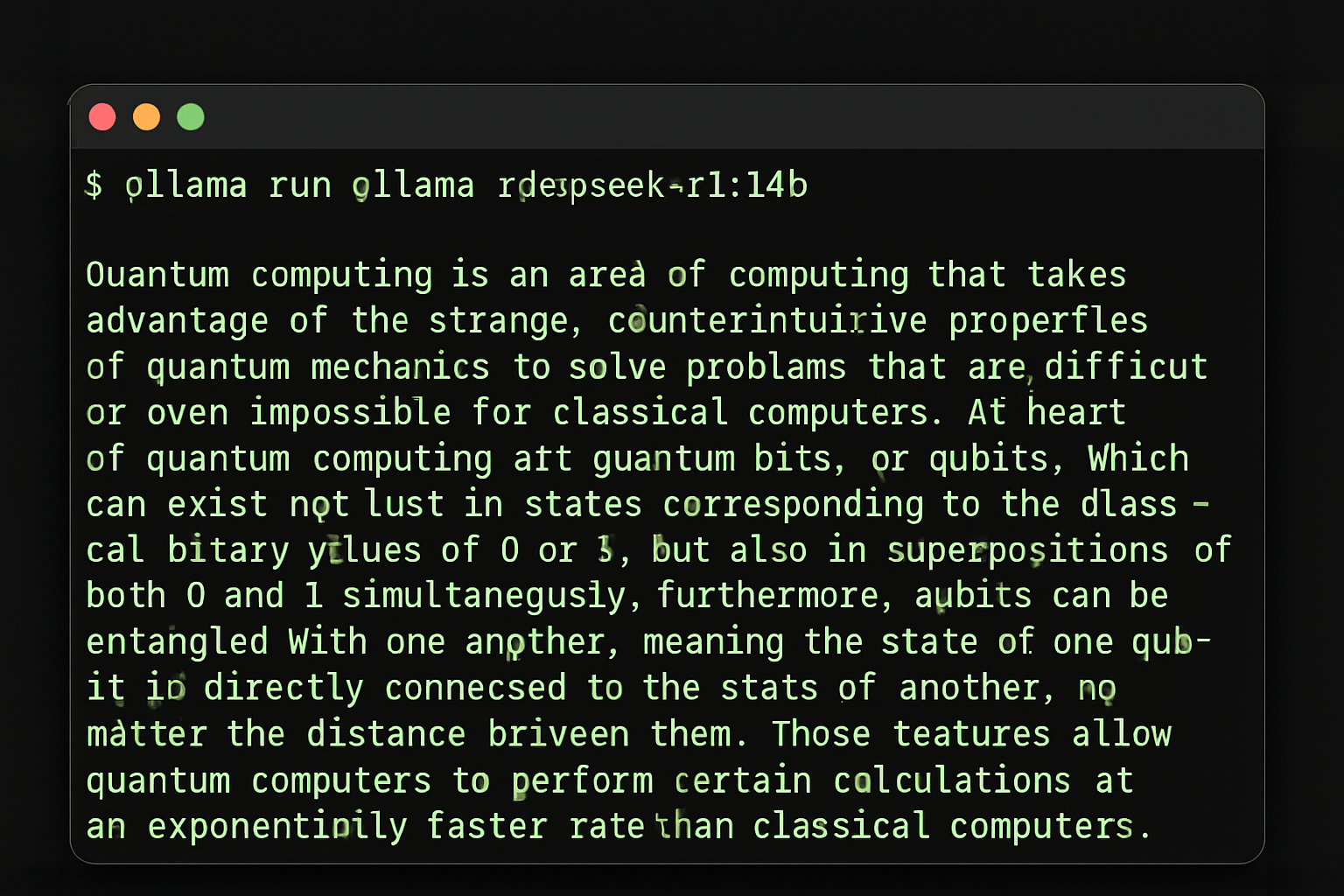

ollama pull deepseek-r1:70bPasso 3: Testar no terminal

ollama run deepseek-r1:14b

Ollama executando DeepSeek R1 — um comando para começar

Passo 4: Adicionar Open WebUI para interface tipo ChatGPT

# Usando Docker (recomendado)

docker run -d \

--name open-webui \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--add-host=host.docker.internal:host-gateway \

-e OLLAMA_BASE_URL=http://host.docker.internal:11434 \

--restart always \

ghcr.io/open-webui/open-webui:main

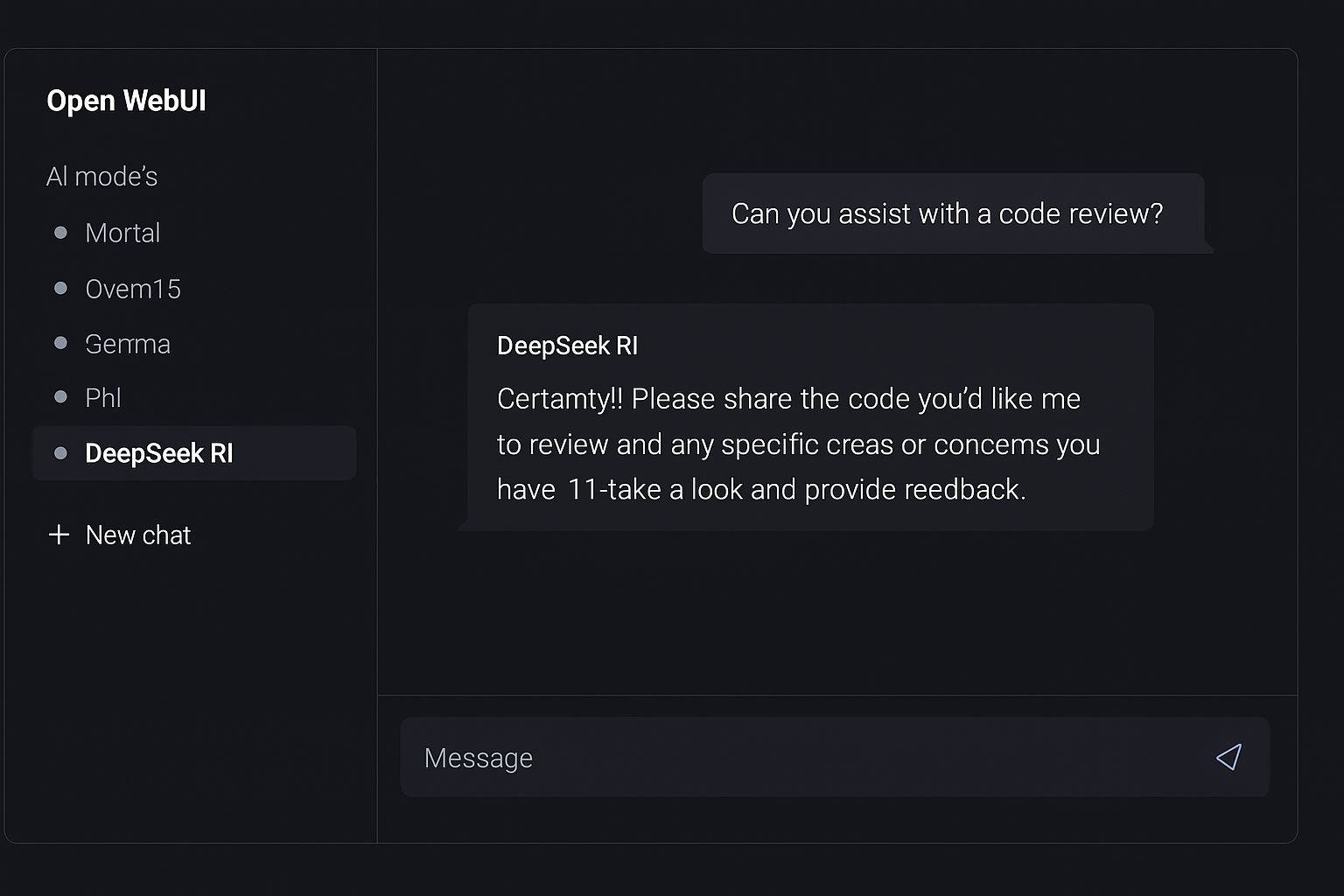

Open WebUI — uma interface tipo ChatGPT para sua IA local

Agora abra http://localhost:3000 no seu navegador. Crie uma conta (é local — o primeiro usuário se torna admin), selecione seu modelo DeepSeek R1 e comece a conversar.

Casos de uso: quando escolher o quê

Escolha ChatGPT quando:

- 🔵Você precisa de IA multimodal (análise de imagens, voz, DALL-E)

- 🔵Você quer manutenção zero e acesso instantâneo

- 🔵Você é usuário solo com uso moderado (~$20/mês está ok)

- 🔵Você precisa de navegação web em tempo real integrada nas respostas

- 🔵Você precisa do modelo mais recente (OpenAI lança atualizações semanais)

Escolha DeepSeek R1 auto-hospedado quando:

- 🟢Privacidade de dados é inegociável (indústrias regulamentadas, código proprietário)

- 🟢Você tem equipe de 3+ (custos escalam de forma plana, não por usuário)

- 🟢Você processa volumes altos (análise em lote, pipelines automatizados)

- 🟢Você precisa de capacidade offline (ambientes air-gapped, viagens)

- 🟢Você quer fazer fine-tune do modelo nos seus dados de domínio

- 🟢Você está construindo IA no seu produto (sem dependência de API)

- 🟢Você quer custos previsíveis (sem contas surpresa)

Conclusão: a jogada inteligente em 2026

Um ano atrás, auto-hospedar IA era um experimento para hobbistas. Hoje, é uma estratégia pronta para produção usada por startups, empresas e desenvolvedores independentes mundialmente.

DeepSeek R1 oferece capacidades de raciocínio que competem com — e em alguns benchmarks excedem — ChatGPT. Ollama torna o deploy trivial. Open WebUI te dá uma interface polida. E você mantém cada byte de dados sob seu controle.

A matemática é simples:

- Equipe de 10 pessoas no ChatGPT Plus: $2.400/ano

- Equipe de 10 pessoas no DeepSeek R1 auto-hospedado: $360/ano

- Economia anual: $2.040 — mais soberania completa de dados

ChatGPT permanece um produto excelente. Mas quando você pode igualar suas capacidades principais a uma fração do custo enquanto mantém seus dados privados, a jogada inteligente é clara.

Pronto para explorar mais ferramentas de IA auto-hospedadas? Navegue nosso diretório curado de aplicações auto-hospedáveis em hostly.sh — de assistentes de IA a plataformas de automação, ajudamos você a encontrar o melhor software open source para rodar na sua própria infraestrutura.

Achou esta comparação útil? Confira nossos outros guias sobre alternativas auto-hospedadas para ferramentas SaaS populares.